clase 01b

Introducción a Redes Convolucionales

Resumen de la Sección: En esta sección introductoria, se aborda la estructura de las imágenes digitales y su representación como matrices de valores. Se explora cómo las imágenes en tonos de grises y a color se componen de píxeles, detallando la codificación RGB y CMYK. Además, se discute la transformación de una matriz de imagen en un vector para el entrenamiento de redes neuronales.

Representación de Imágenes Digitales

- Una imagen digital es esencialmente una matriz de valores que representan los píxeles.

- Las imágenes en tonos de grises tienen valores del 0 al 255, donde 0 es negro y 255 es blanco.

- Las imágenes a color utilizan diferentes codificaciones como RGB (Red Green Blue) o CMYK (Cyan Magenta Yellow Black).

Transformación para Entrenamiento

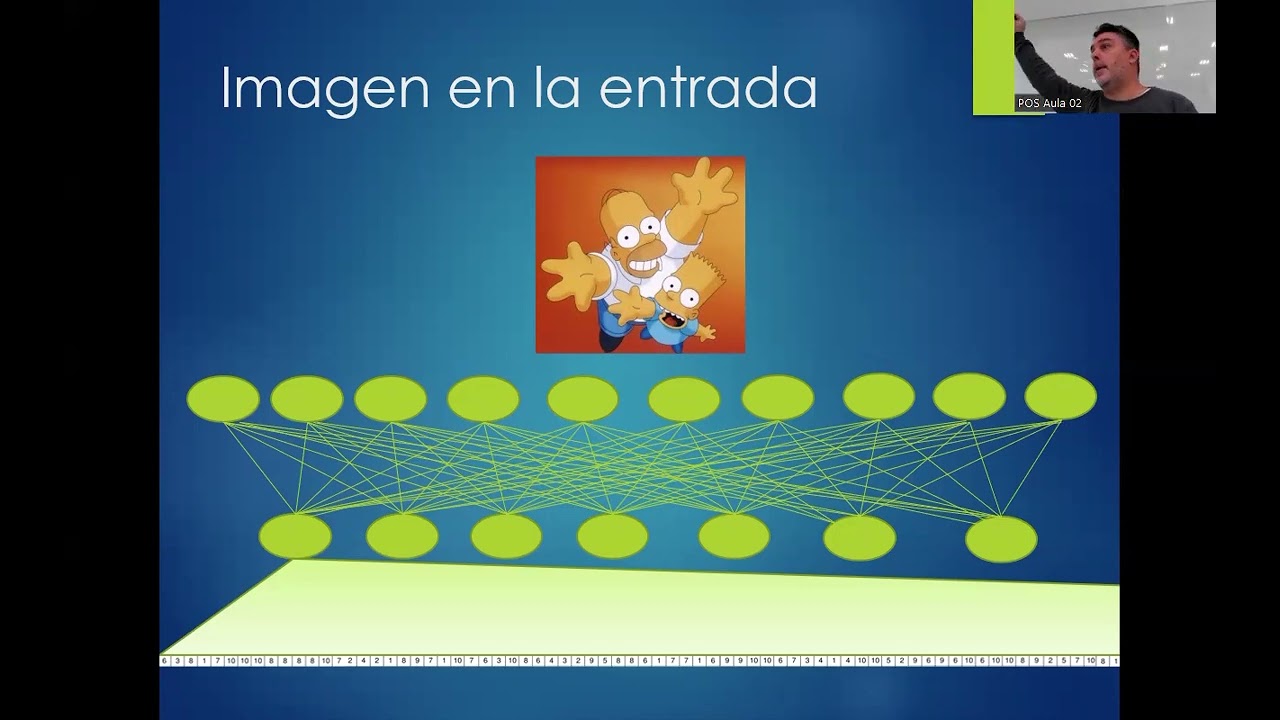

- Para entrenar redes neuronales con imágenes, se aplanan las matrices en vectores.

- A pesar de ser matemáticamente viable, trabajar con grandes dimensiones puede afectar la capacidad efectiva de la red debido al procesamiento intensivo requerido.

Limitaciones del Enfoque Tradicional

Resumen de la Sección: Aquí se analiza por qué el método convencional falla al aplicarse directamente a redes neuronales convolucionales para procesar imágenes complejas.

Desafíos en Redes Neuronales Convencionales

- La limitación radica en que cada neurona debe ponderar todos los píxeles, lo cual no refleja el funcionamiento eficiente del sistema visual humano.

- Comparado con el sistema visual humano que utiliza múltiples neuronas especializadas, asignar toda la información a una sola neurona resulta ineficaz.

Análisis de Redes Neuronales en Espacios de Altas Dimensiones

Resumen de la Sección: En esta sección, se explora cómo las redes neuronales trabajan en espacios de altas dimensiones, específicamente en un espacio de 140,000 dimensiones. Se discute la complejidad y los desafíos que surgen al trazar hiperplanos en este tipo de espacios.

Espacios de Altas Dimensiones

- Las imágenes son puntos en un espacio de 140,000 dimensiones.

- Las neuronas trazan hiperplanos en el espacio para formar regiones donde se agrupan muestras de la misma clase.

- La dificultad radica en la localidad y vecindad en un espacio tan vasto.

Transformación del Espacio

- Cambiar el fondo de una imagen lleva a puntos cercanos a diferentes vértices en el espacio.

- La transformación busca reunir puntos dispersos (imágenes similares) en un mismo sector del nuevo espacio.

Desafíos y Ruido

- El ruido generado por elementos circundantes dificulta detectar patrones claros como perros en imágenes.

- Detectar objetos específicos entre el ruido es una tarea titánica debido a la dispersión de puntos similares.

Concepto Matemático: Convolución

Resumen de la Sección: Aquí se introduce el concepto matemático de convolución y su aplicación dentro del contexto neuronal para procesamiento eficiente.

Definición y Aplicación

- La convolución implica pasar una función sobre otra para generar nuevas representaciones.

- A medida que las funciones se superponen más, aumenta la convolución hasta alcanzar un máximo.

Implementación Práctica

- La convolución se define como el producto entre dos funciones discretas.

Transformaciones de Imágenes y Filtros Convolucionales

Resumen de la Sección: En esta sección, se aborda el tema de las transformaciones de imágenes y los filtros convolucionales utilizados en el procesamiento de imágenes.

Transformaciones de Imágenes

- Las transformaciones se realizan moviendo una ventana 3x3 sobre una matriz original para generar otra matriz con información transformada.

Filtros Convolucionales

- Los filtros convolucionales son utilizados en el procesamiento de imágenes desde la década del 60.

- Históricamente, los filtros se establecían manualmente para detectar características específicas en las imágenes, como bordes o formas.

- Estos filtros permiten detectar líneas verticales, horizontales, círculos y otras características en las imágenes.

- Se empleaba prueba y error para definir los valores de los filtros a mano, resaltando ciertas características deseadas en la imagen.

Concepto de Convolución y Padding

- La convolución implica perder datos en los bordes al aplicar un filtro a una imagen debido a cómo se calculan los valores resultantes.

- El concepto de padding consiste en agregar datos ficticios alrededor de la matriz original para evitar pérdida de información en los bordes durante la convolución.

Stride y Reducción

- El stride determina cada cuántos pasos se aplica el filtro sobre la imagen, influyendo en la cantidad de información analizada y el tamaño del resultado final.

- Tanto el padding como el stride son conceptos clave que afectan el análisis de imágenes tanto en dimensiones unidimensionales como bidimensionales.

Aplicación a Imágenes RGB

- En imágenes RGB con tres canales (rojo, verde, azul), se utilizan tres máscaras o filtros diferentes para cada canal, generando una nueva imagen RGB con características resaltadas según cada canal.

Convolutiones y Redes Convolucionales

Resumen de la Sección: En esta sección, se aborda el concepto de convoluciones en redes neuronales convolucionales, destacando la importancia de los filtros y kernels en el proceso de transformación de imágenes.

Matrices y Convoluciones

- Se trabajan con dos matrices a la salida para realizar una convolución con tres matrices resaltadas en rojo.

- Cada canal tiene un filtro (kernel), determinando la cantidad de filtros necesarios para obtener resultados deseados.

- La cantidad de kernels influye en la salida; cada kernel genera una imagen distinta.

Transformaciones y Kernels

- Cada canal tiene su filtro, representado por las matrices rojas, generando una matriz tridimensional.

- Las matrices tridimensionales forman cubos conocidos como kernels que se aplican a las imágenes.

Concepto de Kernel y Aplicación

Resumen de la Sección: Aquí se profundiza en el concepto de kernel como un cubo tridimensional que se aplica a las imágenes para extraer información relevante.

Kernel y Aplicación

- El kernel es un cubo tridimensional que pasa por el espacio de tres dimensiones de la imagen.

- Cada posición del cubo (kernel) genera un valor específico en la matriz resultante.

Aplicación Práctica: Filtros y Canales

Resumen de la Sección: Se explora cómo los filtros actúan sobre los canales RGB para generar valores finales en las imágenes procesadas.

Filtros y Canales

- Los filtros actúan como máscaras sobre cada canal RGB, combinándose para producir valores finales.

- La cantidad de kernels utilizados afecta directamente la calidad visual final; más kernels pueden generar ruido indeseado.

Ventajas y Aplicaciones Prácticas

Resumen de la Sección: Se discuten las ventajas del uso de convoluciones en redes neuronales convolucionales para procesamiento eficiente e informativo de imágenes.

Ventajas y Aplicaciones

- Las redes convolucionales buscan información eficientemente en imágenes, reduciendo cálculos innecesarios.

Análisis Detallado de Capas Convolucionales

Resumen de la Sección: En esta sección, se profundiza en el funcionamiento y la configuración de las capas convolucionales en redes neuronales.

Objetivo de las Capas Convolucionales

- Las capas convolucionales tienen como objetivo modificar la salida de la red a través de hiperparámetros como el stride, padding y los valores de los kernels.

- Los valores de los kernels son parámetros a aprender para minimizar errores y resolver problemas.

- Se discute cómo determinar el filtro en función del tamaño y canales de la imagen original.

Configuración y Funcionamiento

- La profundidad del kernel coincide con la cantidad de canales de la imagen original.

- Cada kernel produce un solo canal en la salida, lo que influye en el diseño arquitectónico para obtener múltiples canales.

- La cantidad de kernels, alto y ancho del kernel, stride y padding son hiperparámetros clave en una capa convolucional.

Aprendizaje y Optimización

- Los valores aprendidos por la red se utilizan para minimizar errores mediante algoritmos como backpropagation.

- El proceso implica calcular derivadas complejas para ajustar los pesos según el error cometido.

Pretratamiento e Importancia del Aprendizaje

Resumen de la Sección: Se aborda la importancia del pretratamiento en imágenes antes del aprendizaje profundo.

Estrategias para Mejorar el Aprendizaje

- Inicialmente, los filtros se inicializan aleatoriamente pero es crucial ajustarlos durante el entrenamiento.

- Se debate sobre si utilizar filtros conocidos previamente o permitir que el modelo aprenda por sí mismo.

Preprocesamiento Efectivo

- Se sugiere realizar un pretratamiento convolucional utilizando filtros conocidos para mejorar el rendimiento del modelo.

Análisis Detallado del Video

Detección de Bordes en Imágenes RGB

Resumen de la Sección: En esta sección, se discute la detección de bordes en imágenes RGB y cómo los canales individuales contribuyen a este proceso.

- La importancia de los filtros para cada canal en la detección de bordes.

- La posibilidad de que un solo canal delimite un borde visualmente.

- La complejidad de detectar bordes en imágenes RGB debido a la interpretación cerebral.

Red Neuronal Convolucional y Parámetros

Resumen de la Sección: Aquí se aborda el uso de redes neuronales convolucionales y la cantidad significativa de parámetros involucrados.

- Comparación entre una red feedforward y una red convolucional en términos de parámetros.

- Cantidad masiva de datos involucrados al aplicar una red con capa oculta y 64 neuronas.

Función y Objetivo de Filtros en Redes Convolucionales

Resumen de la Sección: Se explora el propósito fundamental detrás del uso específico de filtros en redes convolucionales.

- Objetivo principal: entrenar kernels para detectar diferentes características como bordes verticales u horizontales.

- Incertidumbre sobre lo que realmente está sucediendo dentro del proceso neuronal.

Clasificación Binaria y Capas Convolucionales

Resumen de la Sección: Discusión sobre clasificación binaria y las etapas iniciales dentro del contexto convolucional.

- Diferenciación entre dos redes: una para clasificación binaria y otra para procesamiento adicional.

- Comparación entre salidas esperadas por diferentes modelos aún no explorados completamente.

Submuestreo y Tipos de Pooling

Resumen de la Sección: Explicación sobre submuestreo (subsampling) y sus variantes como Max Pooling o Average Pooling.

- Proceso simplificado mediante subsampling manteniendo constante el número de canales pero reduciendo dimensiones espaciales.

- Distinción entre Max Pooling (selecciona valor máximo relevante) y Average Pooling (calcula promedio).

Análisis Detallado del Video

Perillas y Entrenamiento de Redes Convolucionales

Resumen de la Sección: En esta sección, se discute la importancia de las perillas en el proceso de entrenamiento de redes convolucionales.

- Se menciona la necesidad de ajustar las perillas para lograr un error mínimo en el entrenamiento.

Comparación entre Redes Convolucionales y Capas Convencionales

Resumen de la Sección: Aquí se compara el uso de redes convolucionales con capas convencionales en términos de eficiencia y cantidad de parámetros.

- Se destaca que las redes convolucionales requieren menos parámetros que una capa convencional, lo que las hace más eficientes.

- A pesar del menor número de parámetros, las redes convolucionales han demostrado ser más exitosas empíricamente en tareas como el procesamiento de imágenes.

Preprocesamiento y Limpieza de Imágenes

Resumen de la Sección: La importancia del preprocesamiento adecuado para garantizar un entrenamiento efectivo sin ruido en las imágenes.

- El preprocesamiento es crucial para eliminar ruido e información innecesaria en las imágenes antes del entrenamiento.

- Limpiar las imágenes para reducir el ruido y resaltar los elementos clave como colores o formas es fundamental para el éxito del entrenamiento.

Transformaciones y Subsampling en Redes Convolucionales

Resumen de la Sección: Explicación sobre transformaciones, subsampling y su aplicación en redes convolucionales.

- Las transformaciones son fundamentales para convertir una imagen original a un espacio diferente mediante operaciones como subsampling.

- El subsampling permite descartar píxeles redundantes al calcular promedios o máximos, reduciendo la dimensionalidad y mejorando la eficiencia computacional.

Arquitectura y Funciones en Redes Convolucionales

Resumen de la Sección: Descripción detallada sobre la arquitectura típica y funciones utilizadas en redes convolucionales.

- Una red convolucional consta principalmente de capas convolucionales seguidas por capas de subsampling para generar transformaciones espaciales.

Progresión de las Capas en Redes Neuronales

Resumen de la Sección: En esta parte, se discute cómo las capas de una red neuronal se especializan en detectar objetos más grandes a medida que avanzan.

Evolución de la Especialización de las Capas

- Las capas iniciales detectan bordes y detalles para cambiar texturas y frecuencias.

- Con el avance, las capas se especializan en detectar objetos más grandes como rostros.

- La red progresa hacia la detección de objetos cada vez más grandes sin conocer exactamente qué sucede.

- El factor espacial se mantiene constante a lo largo de toda la red, evitando interferencias entre píxeles.

Parámetros Clave en Redes Neuronales Convolucionales

Resumen de la Sección: Aquí se detallan los parámetros esenciales a considerar al diseñar redes neuronales convolucionales.

Consideraciones Importantes

- Importancia de la cantidad de kernels, el stride, el zero padding y el tamaño de los filtros.

- Posibilidad de establecer diferentes tamaños para los kernels según el diseño deseado.

Entrenamiento y Actualización en Modelos CNN

Resumen de la Sección: Se aborda el proceso completo desde entrenamiento hasta actualización en modelos basados en redes neuronales convolucionales.

Proceso de Entrenamiento

- Tras las convoluciones, se añade una capa fully connected para entrenar una arquitectura clásica.

- El entrenamiento completo implica presentar imágenes, calcular errores y actualizar pesos iterativamente.

Optimización del Modelo y Supervisión del Error

Resumen de la Sección: Aquí se explora cómo optimizar un modelo mediante supervisión del error durante el proceso iterativo.

Supervisión del Error

- La dimensionalidad del error es crucial; se ajusta mediante cálculo iterativo y actualización por lotes.

- Las gráficas reflejan la disminución progresiva del error durante épocas repetidas con métricas definitorias al final.

Ajuste Fino y Estrategias en Redes Neuronales CNN

Resumen de la Sección: Discusión sobre estrategias como fine tuning o ajuste fino en redes neuronales convolucionales.

Estrategias Flexibles

Hardware y Procesamiento Paralelo

Resumen de la Sección: En esta sección, se discute la importancia del hardware en el procesamiento de datos y cómo el uso de GPU con múltiples núcleos puede acelerar significativamente los tiempos de entrenamiento.

Aceleración del Entrenamiento con GPU

- Una GPU con 128 núcleos puede reducir el tiempo de entrenamiento de un modelo de 24 horas a solo 15 minutos.

- La adquisición y comprensión del hardware adecuado para trabajar eficientemente en proyectos de procesamiento de datos puede ser un desafío.

- El costo y la disponibilidad del hardware especializado, como las GPUs, pueden ser significativos para proyectos que requieren un alto rendimiento computacional.

Procesamiento Paralelo y Distribuido

- El procesamiento paralelo es fundamental para manejar múltiples operaciones simultáneas, lo que hace que las GPUs sean ideales para este propósito.

- Frameworks como TensorFlow permiten aprovechar al máximo el hardware disponible en una sola computadora para lograr un procesamiento distribuido eficiente.

Frameworks de Procesamiento: TensorFlow y Keras

Resumen de la Sección: Se exploran los frameworks populares como TensorFlow y Keras, utilizados para implementar redes neuronales y realizar tareas de aprendizaje profundo.

Evolución de Frameworks

- La cantidad de núcleos disponibles en una GPU influye directamente en la capacidad de realizar operaciones simultáneas.

- TensorFlow ha sido uno de los frameworks más conocidos durante años, pero competidores como PyTorch están ganando popularidad debido a su enfoque más intuitivo.

Uso Práctico con Keras

- Keras facilita la programación en Python para construir redes neuronales, ofreciendo compatibilidad con CUDA para aprovechar el poder computacional de las GPUs.

Entrenamiento de Redes Neuronales

Resumen de la Sección: En esta sección, se aborda el entrenamiento de redes neuronales, incluyendo algoritmos, métricas, arquitectura y optimización.

Algoritmos de Entrenamiento

- Se menciona el algoritmo SGD (Gradiente Estocástico Descendente) como una opción para modificar los pesos durante el entrenamiento.

Métricas y Errores

- Se discute sobre el error cuadrático medio (MS) como una métrica común en el entrenamiento.

Arquitectura y Éxito

- La importancia de una arquitectura bien formada para lograr éxito en el entrenamiento.

Proceso de Entrenamiento

- Detalles sobre cómo minimizar la función de pérdida durante el entrenamiento con métodos como Fit y especificaciones del dataset.

Post-Entrenamiento

- Después del entrenamiento, se obtiene un modelo entrenado con estadísticas que pueden ser consultadas.

Arquitectura de Redes Neuronales

Resumen de la Sección: Aquí se profundiza en la arquitectura específica de las redes neuronales, incluyendo capas ocultas, funciones de activación y criterios para clasificación.

Capas Ocultas y Salida

- Explicación detallada sobre las capas ocultas en una red neuronal con ejemplos numéricos.

Clasificación y Funciones Específicas

- Uso común de la función softmax en la capa de salida para clasificación.

Función de Pérdida en Clasificación

- Discusión sobre la función categórica Cross Entropy como función de pérdida común en problemas clasificación.

Optimización y Compilación

Resumen de la Sección: En este segmento se aborda la optimización del modelo mediante distintos optimizadores y su aplicación durante la compilación.

Selección del Optimizador

- Comparativa entre diferentes funciones para minimizar errores locales durante el proceso optimización del modelo.

Optimizadores Personalizados

Análisis Detallado del Video

Tamaño de las Fotos y Relación con Dimensiones (T=5587s - 5659s)

- Se discute la importancia de que todas las fotos tengan el mismo tamaño, lo que implica tener un ancho, alto y profundidad definidos.

- Para acceder a un valor en una foto se necesitan cuatro dimensiones debido a la relación plano con dos dimensiones.

Input Shape y Librerías Utilizadas (T=5688s - 5743s)

- Se menciona la necesidad de establecer el input shape basado en el ancho, alto y canales de la imagen para trabajar con librerías específicas.

- Las librerías actuales requieren información detallada sobre cada muestra, incluyendo alto, ancho y profundidad.

Convoluciones y Pooling en Redes Neuronales (T=5743s - 5865s)

- Se introduce una capa convolucional 2D con filtros para procesar imágenes.

- Explicación sobre el padding same para mantener las dimensiones al aplicar convoluciones.

- Agregando una capa de Max pooling para subsampling en cuadraditos 2x2.

- Discusión sobre diferentes tipos de pooling como Max pooling, Min pooling y Average pooling.

Composición y Entrenamiento del Modelo (T=5893s - 6052s)

- Se aborda la composición de capas convolucionales seguida por pooling en redes neuronales.

- Descripción del proceso de flaten para generar un único vector independientemente del ancho y canales.

- El objetivo principal del pooling es reducir las dimensiones espaciales basándose en valores similares entre píxeles contiguos.

- Múltiples opciones para capas densas dependiendo del tipo de clasificación a realizar.

Compilación y Entrenamiento del Modelo (T=6052 s - 6137 s)

- Compilación del modelo utilizando optimizador Adam y métricas específicas para clasificación.

- Proceso de entrenamiento utilizando fit con datos estructurados según las necesidades del modelo.

- Facilidad proporcionada por librerías al manejar imágenes durante el entrenamiento.

Clasificación de Imágenes con Deep Learning

Resumen de la Sección: En esta sección, se discute el proceso de clasificación de imágenes utilizando Deep Learning y cómo se pueden organizar las imágenes en subdirectorios para facilitar el entrenamiento del modelo.

Organización de Imágenes en Subdirectorios

- Se sugiere organizar las imágenes en subdirectorios correspondientes a cada clase (por ejemplo, perro, gato, elefante, jirafa).

- Cada muestra se asigna a una clase según la imagen dentro del subdirectorio correspondiente, lo que facilita la generación del conjunto de datos de entrenamiento.

- El proceso implica preparar las imágenes en sus respectivos subdirectorios y luego utilizar el Image Data Generator y Flow from Directory para realizar la clasificación.

Transfer Learning y Actualización de Modelos

- Se menciona la importancia del Transfer Learning para actualizar modelos existentes con nuevas muestras, como humanos con diferentes características faciales.

- El Transfer Learning permite utilizar un modelo preentrenado como punto inicial para entrenar con nuevas muestras, adaptándose a cambios como detectar humanos con diferentes características faciales.

Reconocimiento Facial y Seguridad

- Se destaca un software de seguridad que identifica a las personas mediante una sola foto, resaltando la importancia del reconocimiento facial en aplicaciones de seguridad.

- En el reconocimiento facial, se utilizan descriptores complejos para transformar los rostros en vectores característicos que permiten comparaciones precisas entre imágenes.

Verificación Biométrica y Seguridad Adicional

- La verificación biométrica involucra comparar características específicas como surcos o descriptores faciales para garantizar la autenticidad de una persona.

Men and Facial Features

Resumen de la Sección: En esta sección, se discute cómo los rasgos faciales, como la distancia entre los ojos, no cambian a medida que envejecemos, a menos que ocurra un accidente. También se menciona la posibilidad de reconocer a una persona incluso si está golpeada.

Detalles sobre Rasgos Faciales

- Se destaca que las características fisionómicas del rostro no cambian con la edad, salvo por lesiones.

- Existe la posibilidad de reconocer a alguien aunque esté golpeado debido a ciertos rasgos faciales distintivos.

Guardado y Uso de Modelos

Resumen de la Sección: Aquí se aborda el proceso de guardar y utilizar modelos en machine learning, centrándose en los parámetros guardados y su arquitectura.

Proceso de Guardado y Uso

- Al guardar un modelo, se almacenan los parámetros (valores W) y la arquitectura para futuras predicciones.

- Tras levantar un modelo, este queda listo para predecir al tener asignados todos los parámetros correspondientes.

Metadatos y Funciones de Activación

Resumen de la Sección: La discusión gira en torno a los metadatos en machine learning y las opciones disponibles para evaluar funciones de activación.

Metadatos y Evaluación

- Los metadatos son cruciales para comprender cómo funcionan los modelos en el día a día.