大语言模型微调之道4——指令微调

课程介绍

- 介绍了指导微调,使GPT-3转变为Chat GPT,提供聊天功能。

- 指导微调教模型遵循指令,表现更像聊天机器人,提高用户交互体验。

- 使用对话数据集或指令响应数据集进行指导微调,数据可来源于FAQ、客服对话或Slack消息。

数据准备和训练

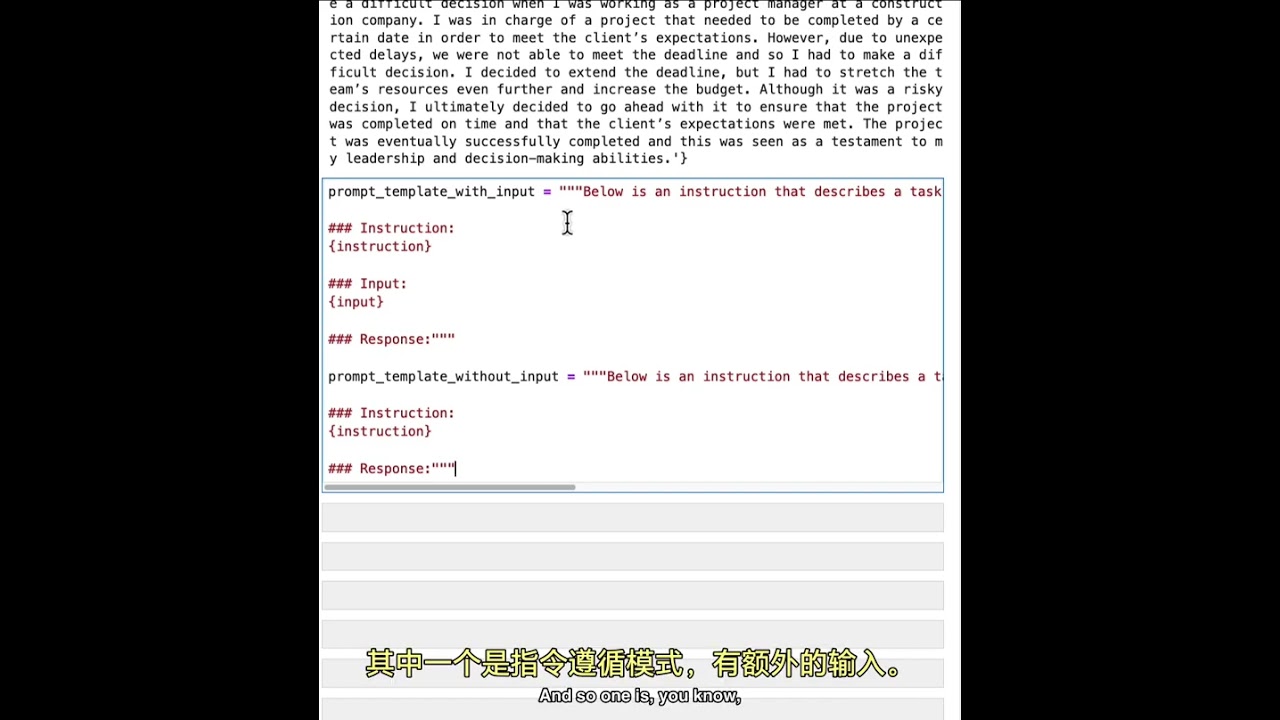

- 若无数据集可将数据转换为问答格式或指令跟随格式,使用提示模板实现。

- 微调教新行为给模型,并推广至未提供的领域,如代码问题回答。

微调步骤和评估

- 微调包括数据准备、训练和评估。迭代过程中改进模型并针对特定任务定制数据。

- Chat GPT研究表明模型能回答关于代码的问题即使未接受相关微调。

实验室操作和比较模型

- 导入库并加载alpaca数据集进行实验比较已经进行和未进行指导微调的模型效果。

- 加载alpaca数据集以及查看示例,并探索不同类型的提示模板。

模型对比与展望

模型参数和数据处理

- 模型参数估计约为70亿,包括大型和小型模型。

- 加载两个不同的数据处理项以及运行模型。

- 使用公司数据集提出问题并运行模型进行推断。

技术文档生成能力

- Lamini可以生成软件项目的技术文档和用户手册。

- 尽管回答有误,但模型理解了问题的一部分。

微调后的模型表现