Uncertainty - Lecture 2 - CS50's Introduction to Artificial Intelligence with Python 2020

Introduction to Artificial Intelligence with Python

Dans cette introduction à l'intelligence artificielle avec Python, nous allons explorer comment l'IA peut représenter les connaissances et utiliser des informations probabilistes pour tirer des conclusions. Nous commencerons par examiner les fondements mathématiques de la théorie des probabilités.

Représentation des connaissances

- L'IA représente les connaissances sous forme de phrases logiques dans différents langages logiques.

- Le but est d'utiliser ces informations pour déduire de nouvelles informations via l'inférence.

Incertitude et probabilité

- Les ordinateurs et l'IA ne peuvent pas toujours savoir quelque chose avec certitude, il y a souvent une certaine incertitude dans les informations qu'ils traitent.

- L'utilisation de la probabilité permet à l'IA de prendre en compte cette incertitude et d'en tirer des conclusions.

- La probabilité représente la vraisemblance d'un événement ou d'une information.

Utilisation de la probabilité

- La probabilité est utilisée pour faire des inférences et prendre des décisions basées sur une connaissance imparfaite.

- Par exemple, un robot explorant un environnement peut utiliser des données sensorielles pour inférer sa position avec une certaine probabilité.

- La prédiction météorologique est un autre exemple où la probabilité est utilisée pour estimer le temps futur en fonction des données actuelles et passées.

Théorie des probabilités

- La théorie des probabilités fournit les bases mathématiques pour comprendre les concepts clés liés à la probabilité.

- Les valeurs de probabilité doivent être comprises entre zéro et un inclus.

- La somme de toutes les probabilités des événements possibles doit être égale à un.

Exemple avec un dé

- Un dé équitable a six résultats possibles, chacun ayant une probabilité égale de se produire (1/6).

- Les probabilités peuvent varier entre zéro (événement impossible) et un (événement certain).

Fondements mathématiques de la théorie des probabilités

Dans cette section, nous allons explorer les concepts clés de la théorie des probabilités et comment ils sont utilisés pour représenter des modèles dans l'IA.

Monde possible et probabilité

- La théorie des probabilités repose sur l'idée qu'il existe plusieurs mondes possibles représentés par le symbole grec oméga.

- Chaque monde possible a une certaine probabilité d'être vrai.

- La notation P(ω) représente la probabilité d'un monde possible ω.

Axiomes de la probabilité

- Toutes les valeurs de probabilité doivent être comprises entre zéro et un inclus.

- La somme de toutes les probabilités des mondes possibles doit être égale à un.

Utilisation pratique de la sommation

- La notation sigma (∑) est utilisée pour représenter une sommation, c'est-à-dire l'addition d'une séquence de valeurs.

- Dans le contexte de la théorie des probabilités, nous utilisons souvent cette notation pour ajouter les différentes valeurs individuelles ou les différentes probabilities afin d'obtenir une valeur globale.

Exemple avec un dé équitable

- Si nous lançons un dé équitable, chaque résultat a une probabilité de 1/6.

- En ajoutant toutes les probabilités des résultats possibles (1/6 + 1/6 + 1/6 + 1/6 + 1/6 + 1/6), nous obtenons la somme de un, ce qui signifie que toutes les probabilités doivent se sommer à un.

Les probabilités avec un dé

Aperçu de la section: Dans cette section, nous explorons les probabilités en utilisant un seul dé. Nous considérons la probabilité d'obtenir un certain nombre sur le dé et comment cela peut varier en fonction du nombre de faces du dé.

- La probabilité d'obtenir un certain nombre sur un dé n'est pas certaine, mais elle est légèrement supérieure à zéro.

- Lorsque nous avons deux dés, nous pouvons commencer à réfléchir à la probabilité de lancer une somme spécifique des deux dés.

- Nous pouvons représenter toutes les combinaisons possibles des deux dés et noter que chaque combinaison est également probable.

- Cependant, toutes les sommes possibles ne sont pas également probables. Certaines sommes ont plus de chances de se produire que d'autres.

- Par exemple, la somme de sept a plus de chances de se produire que la somme de douze lorsque nous lançons deux dés équitables.

Probabilité conditionnelle

Aperçu de la section: Dans cette section, nous abordons la notion de probabilité conditionnelle. Il s'agit d'évaluer la probabilité d'un événement donné en tenant compte des informations préalablement connues.

- La probabilité conditionnelle est basée sur des preuves ou des informations préalables déjà révélées.

- Elle est représentée par P(A|B), où A est l'événement dont nous voulons connaître la probabilité et B est l'évidence ou l'information préalable.

- La probabilité conditionnelle est souvent utilisée pour prendre des décisions ou faire des prédictions en tenant compte de certaines informations préalables.

Utilisation de la probabilité conditionnelle

Aperçu de la section: Dans cette section, nous explorons l'utilisation pratique de la probabilité conditionnelle dans divers scénarios.

- La probabilité conditionnelle est utile pour évaluer la probabilité qu'il pleuve aujourd'hui, sachant qu'il a plu hier.

- Elle peut également être utilisée pour évaluer la probabilité que notre itinéraire optimal vers une destination change en fonction des informations préalables disponibles.

- La probabilité conditionnelle est un outil puissant pour prendre des décisions et faire des prédictions basées sur les connaissances préalables.

Introduction to Conditional Probability

In this section, the speaker introduces the concept of conditional probability and its importance in reasoning with evidence. The formula for calculating conditional probability is explained.

Understanding Conditional Probability

- Conditional probability is used to determine the likelihood of an event given certain evidence or conditions.

- It allows for more accurate reasoning by taking into account available evidence.

- The formula for conditional probability is P(A|B) = P(A and B) / P(B), where P(A|B) represents the probability of A given B.

Calculation of Conditional Probability

This section focuses on how to calculate conditional probability using the provided formula. An example involving rolling two dice is used to illustrate the concept.

Example: Rolling Two Dice

- The unconditional probability of rolling two dice and getting a sum of 12 is 1/36.

- To calculate the conditional probability of getting a sum of 12 given that one die rolled a six, we need to consider relevant possibilities.

- The probability that one die rolls a six is 1/6, as there are six possible outcomes for each die roll.

- The only case where both dice sum up to 12 is when both dice roll a six, which has a probability of 1/36.

- Dividing these probabilities (1/36 divided by 1/6), we find that the conditional probability is also 1/6.

Joint Probability and Different Representations

This section discusses joint probability and different ways to represent it mathematically. Various equivalent equations are presented.

Joint Probability Representation

- Joint probability refers to the simultaneous occurrence or combination of multiple events.

- It can be represented as P(A and B) or P(B and A), as the order of events does not matter.

- The probability of A and B can also be expressed as the product of the individual probabilities: P(A) * P(B|A) or P(B) * P(A|B).

Conditional Probability Formula Variations

This section explores different variations of the conditional probability formula and their usefulness in reasoning about probability.

Different Representations of Conditional Probability

- The conditional probability formula can be written in various ways, such as P(A|B) = (P(A and B)) / (P(B)) or P(A|B) = (P(B) * P(A|B)) / (P(B)).

- These representations provide different perspectives on joint probability and conditional probability relationships.

- Understanding these variations helps in drawing conclusions about real-world probabilities.

Conclusion

Conditional probability is a fundamental concept in reasoning with evidence. By considering available information, we can calculate the likelihood of an event occurring. The formula for conditional probability allows us to make more informed decisions based on evidence.

Introduction to Random Variables and Probability Distributions

Cette section introduit les variables aléatoires et les distributions de probabilité.

Les variables aléatoires

- Une variable aléatoire est une variable qui peut prendre différentes valeurs avec des probabilités associées.

- Par exemple, une variable aléatoire "Roll" peut avoir six valeurs possibles : 1, 2, 3, 4, 5 ou 6.

- D'autres exemples de variables aléatoires incluent la météo (soleil, nuageux, pluvieux), le trafic (aucun, léger, dense) et les vols (à l'heure, retardé, annulé).

Les distributions de probabilité

- Une distribution de probabilité associe à chaque valeur possible d'une variable aléatoire sa probabilité.

- Par exemple, pour la variable aléatoire "Flight" avec les valeurs possibles "à l'heure", "retardé" et "annulé", la distribution de probabilité peut être représentée par un vecteur [0.6, 0.3, 0.1].

- La somme des probabilités pour toutes les valeurs possibles doit être égale à 1.

Independence in Probability Theory

Cette section explique le concept d'indépendance dans la théorie des probabilités.

Indépendance entre événements

- Deux événements sont indépendants si la connaissance de l'un n'influence pas la probabilité de l'autre.

- Par exemple, dans le cas du lancer de deux dés rouges et bleus, le résultat du dé rouge n'affecte pas la probabilité du dé bleu.

- Cependant, certains événements peuvent ne pas être indépendants, comme les nuages et la pluie.

Formule mathématique de l'indépendance

- La probabilité de deux événements A et B est égale à la probabilité de A multipliée par la probabilité de B sachant que A est vrai.

- Si A et B sont indépendants, alors la probabilité de B sachant que A est vrai est simplement égale à la probabilité de B.

Conclusion

Les variables aléatoires permettent de modéliser des situations où les résultats sont incertains. Les distributions de probabilité associent des probabilités aux différentes valeurs possibles d'une variable aléatoire. L'indépendance entre événements est un concept important en théorie des probabilités pour déterminer si la connaissance d'un événement influence ou non la probabilité d'un autre événement.

Indépendance des événements

Aperçu de la section: Dans cette section, nous examinons ce que signifie l'indépendance des événements et comment la calculer. Nous utilisons l'exemple de dés pour illustrer ces concepts.

Indépendance des événements

- Deux événements a et b sont indépendants si la probabilité de leur intersection est égale au produit de leurs probabilités individuelles.

- Par exemple, dans le cas des dés, la probabilité d'obtenir un 6 sur le dé rouge et un 6 sur le dé bleu est égale à la probabilité d'obtenir un 6 sur le dé rouge multipliée par la probabilité d'obtenir un 6 sur le dé bleu (1/36).

- Cependant, si nous voulions calculer la probabilité d'obtenir un 6 sur le dé rouge et un 4 sur le dé rouge, cela ne serait pas indépendant car il n'est pas possible d'obtenir deux valeurs différentes lors du lancer du même dé.

Probabilité conditionnelle

Aperçu de la section: Dans cette section, nous introduisons la notion de probabilité conditionnelle et expliquons comment elle diffère de l'indépendance des événements.

Probabilité conditionnelle

- La probabilité conditionnelle est utilisée lorsque les événements ne sont pas indépendants.

- Pour calculer la probabilité d'un événement donné sachant qu'un autre événement s'est déjà produit, on utilise la formule de la probabilité conditionnelle.

- Par exemple, si nous voulons calculer la probabilité d'obtenir un 4 sur le dé rouge sachant que le dé rouge est déjà un 6, cette probabilité est nulle car il est impossible d'obtenir à la fois un 6 et un 4 lors du lancer du même dé.

Règle de Bayes

Aperçu de la section: Dans cette section, nous introduisons la règle de Bayes et expliquons son importance en matière d'inférence probabiliste.

Règle de Bayes

- La règle de Bayes permet d'exprimer une probabilité conditionnelle en utilisant des informations inverses.

- La formule générale de la règle de Bayes est : Probabilité de b sachant a = (Probabilité de a sachant b * Probabilité de b) / Probabilité de a.

- Cette règle est essentielle pour l'inférence probabiliste car elle permet d'estimer une probabilité conditionnelle à partir d'autres connaissances probabilistes.

Exemple pratique : Probabilité qu'il pleuve l'après-midi

Aperçu de la section: Dans cette section, nous utilisons un exemple concret pour illustrer comment appliquer la règle de Bayes pour inférer une probabilité conditionnelle.

Exemple pratique : Probabilité qu'il pleuve l'après-midi

- Nous considérons deux événements : nuageux le matin et pluvieux l'après-midi.

- Nous voulons calculer la probabilité qu'il pleuve l'après-midi sachant qu'il est nuageux le matin.

- En utilisant la règle de Bayes, nous pouvons exprimer cette probabilité conditionnelle en termes de la probabilité qu'il soit nuageux le matin sachant qu'il pleut l'après-midi.

- Cette approche permet d'inférer des informations probabilistes à partir de connaissances préalables.

Les sections suivantes du transcript n'ont pas été incluses car elles ne contiennent pas suffisamment d'informations pour être résumées.

Analyse de probabilité conditionnelle

Aperçu de la section: Dans cette partie, le conférencier explique comment utiliser les probabilités conditionnelles pour calculer des informations inverses. Il utilise l'exemple du temps qu'il fait le matin et l'après-midi pour illustrer ce concept.

Probabilité de pluie l'après-midi en fonction des nuages du matin

- La probabilité de pluie l'après-midi étant donné qu'il y a des nuages le matin peut être calculée à l'aide de la règle de Bayes.

- En utilisant les probabilités conditionnelles inverses, on peut déterminer que la probabilité de pluie étant donné des nuages est égale à la probabilité des nuages étant donné une pluie multipliée par la probabilité de pluie, le tout divisé par la probabilité des nuages.

- En utilisant les valeurs fournies dans cet exemple (80% de jours avec nuages si pluvieux, 10% de jours avec pluie et 40% de jours avec nuages), on peut calculer que la probabilité d'avoir une pluie l'après-midi étant donné qu'il y a eu des nuages le matin est égale à 0.2.

Calculer une cause inconnue à partir d'un effet visible

Aperçu de la section: Le conférencier explique comment utiliser les probabilités conditionnelles pour calculer une cause inconnue à partir d'un effet visible. Il donne des exemples dans le domaine médical et de la détection de contrefaçons.

Calculer la probabilité d'une maladie étant donné un résultat de test médical

- En connaissant la probabilité d'un résultat de test médical donné une maladie, on peut calculer la probabilité d'avoir cette maladie étant donné ce résultat.

- Cela est utile car il est souvent plus facile d'obtenir des données sur les résultats de tests que sur la présence réelle d'une maladie.

- De manière similaire, on peut également calculer la probabilité qu'un billet soit contrefait étant donné qu'il présente un texte flou autour des bords.

Probabilités conjointes

Aperçu de la section: Le conférencier introduit les probabilités conjointes et explique comment elles permettent de considérer simultanément plusieurs événements.

Utilisation des probabilités conjointes pour obtenir des informations supplémentaires

- Les probabilités conjointes permettent de déterminer les distributions probabilistes pour plusieurs variables aléatoires.

- En utilisant une table de probabilités conjointes, on peut calculer des informations telles que les probabilités conditionnelles.

- Par exemple, en utilisant une table de probabilités conjointes pour les nuages du matin et la pluie l'après-midi, on peut déterminer la probabilité qu'il soit à la fois nuageux et pluvieux.

Ces sections couvrent les principaux concepts abordés dans le transcript.

Probabilité conditionnelle

Aperçu de la section: Dans cette section, nous explorons comment calculer la probabilité conditionnelle en utilisant des exemples concrets.

Calcul de la probabilité conditionnelle

- La probabilité d'un événement donné un autre événement est égale à la probabilité des deux événements divisée par la probabilité du deuxième événement.

- Nous pouvons représenter la distribution de probabilités conditionnelles en utilisant une constante alpha pour simplifier les calculs.

- La distribution conditionnelle d'un événement C étant donné un autre événement B est proportionnelle à la probabilité conjointe de C et B.

Normalisation des valeurs

- Pour obtenir une distribution de probabilités valide, nous devons normaliser les valeurs afin qu'elles se somment à 1.

- En multipliant les valeurs par une constante appropriée, nous pouvons obtenir une somme totale de 1 pour les probabilités.

Règles importantes sur les probabilités

Aperçu de la section: Dans cette section, nous examinons quelques règles importantes sur les probabilités qui seront utiles dans nos analyses probabilistes.

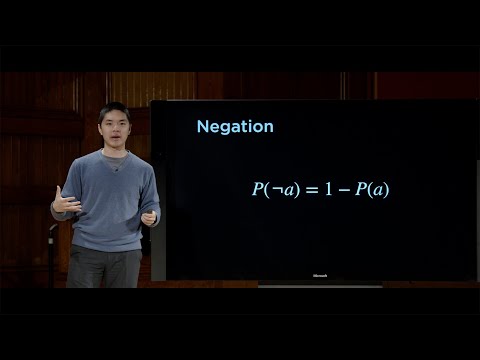

Règle de négation

- La probabilité que l'événement A ne se produise pas est égale à un moins la probabilité que A se produise.

Règle d'inclusion-exclusion

- La probabilité de l'événement A ou B se produit est égale à la somme des probabilités de A et B, moins la probabilité que les deux se produisent simultanément.

Utilisation des règles de probabilité

- Ces règles nous permettent de calculer différentes combinaisons de probabilités pour résoudre des problèmes plus complexes.

La règle de marginalisation

Aperçu de la section: Cette section explique la règle de marginalisation et comment elle permet de calculer la probabilité d'un événement en utilisant une autre variable.

Règle de marginalisation

- La marginalisation consiste à calculer la probabilité d'un événement en utilisant une autre variable.

- Pour calculer la probabilité d'un événement a, on peut considérer deux cas : a et b se produisent ensemble ou a se produit sans que b se produise.

- Ces deux cas sont mutuellement exclus, ce qui signifie qu'ils ne peuvent pas se produire simultanément.

- En additionnant les probabilités des deux cas, on obtient la probabilité que a se produise dans son ensemble.

Probabilités conditionnelles et disjointes

Aperçu de la section: Cette section explique comment utiliser les probabilités conditionnelles pour calculer des probabilités disjointes.

Utilisation des probabilités conditionnelles

- Si l'on connaît les probabilités conditionnelles des événements a et b, on peut utiliser ces informations pour calculer la probabilité que a se produise.

- On considère les deux cas possibles : b se produit ou b ne se produit pas.

- La probabilité que a se produise est égale à la probabilité que a et b se produisent multipliée par la probabilité que b se produise, plus la probabilité que a se produise sachant que b ne se produit pas.

Marginalisation avec des variables aléatoires

Aperçu de la section: Cette section explique comment appliquer la règle de marginalisation à des variables aléatoires qui peuvent prendre plusieurs valeurs.

Règle de marginalisation pour les variables aléatoires

- Lorsque les variables sont des variables aléatoires pouvant prendre plusieurs valeurs, on utilise une notation de sommation pour calculer la probabilité d'un événement.

- La probabilité que la variable x prenne une valeur xi est égale à la somme des probabilités que x prenne cette valeur donnée toutes les valeurs possibles que y peut prendre.

Exemple concret de marginalisation

Aperçu de la section: Cette section donne un exemple concret d'application de la règle de marginalisation.

Exemple avec une distribution conjointe

- On a une distribution conjointe représentée dans un tableau.

- On souhaite connaître la probabilité qu'il fasse nuageux.

- En utilisant la règle de marginalisation, on considère l'autre variable, ici s'il pleut ou non.

- On additionne les probabilités pour chaque cas possible : nuageux et pluvieux, nuageux et non pluvieux.

- En additionnant ces deux valeurs, on obtient la probabilité inconditionnelle qu'il fasse nuageux.

Marginalisation avec des distributions plus complexes

Aperçu de la section: Cette section explique comment appliquer la règle de marginalisation à des distributions plus complexes avec plusieurs valeurs possibles.

Utiliser la règle de marginalisation avec des distributions complexes

- Lorsque les variables peuvent prendre plusieurs valeurs dans un domaine de valeurs possibles, on utilise une notation de sommation pour calculer la probabilité d'un événement.

- On considère tous les cas possibles et on conditionne sur une variable donnée pour obtenir la probabilité inconditionnelle.

Utilité de la marginalisation

Aperçu de la section: Cette section explique pourquoi la marginalisation est utile et comment elle permet de calculer des probabilités individuelles à partir de distributions conjointes.

Utilité de la marginalisation

- La marginalisation permet de passer des distributions conjointes à des probabilités individuelles.

- Cela peut être utile pour calculer des probabilités inconditionnelles qui nous intéressent spécifiquement.

La règle de conditionnement

Aperçu de la section: Cette section présente la règle du conditionnement, similaire à celle de la marginalisation mais utilisant des probabilités conditionnelles.

Règle du conditionnement

- Si l'on dispose des probabilités conditionnelles plutôt que des probabilités conjointes, on peut utiliser cette règle pour calculer les probabilités d'événements.

- La probabilité que a se produise est égale à la probabilité que a se produise sachant que b se produit multipliée par la probabilité que b se produise, plus la probabilité que a se produise sachant que b ne se produit pas.

Conditionnement avec plusieurs valeurs possibles

Aperçu de la section: Cette section explique comment appliquer le conditionnement à des variables aléatoires pouvant prendre plusieurs valeurs.

Règle du conditionnement pour les variables aléatoires

- Lorsque les variables sont des variables aléatoires pouvant prendre plusieurs valeurs, on utilise une notation de sommation pour calculer la probabilité d'un événement.

- On considère tous les cas possibles et on conditionne sur une variable donnée pour obtenir la probabilité inconditionnelle.

Les réseaux bayésiens

Dans cette section, nous allons explorer les réseaux bayésiens, qui sont des modèles probabilistes utilisés pour représenter les dépendances entre différentes variables aléatoires.

Structure d'un réseau bayésien

- Un réseau bayésien est un graphe dirigé composé de nœuds représentant des variables aléatoires.

- Chaque nœud a une distribution de probabilité conditionnelle basée sur ses parents dans le graphe.

- Les flèches reliant les nœuds indiquent la dépendance entre les variables.

Exemple d'un réseau bayésien

- Imaginons un exemple où nous voulons modéliser la probabilité d'arriver à un rendez-vous à l'heure en fonction de plusieurs facteurs.

- Nous avons des nœuds représentant la pluie, la maintenance sur la voie ferrée, le retard du train et l'arrivée au rendez-vous.

- Chaque nœud a une distribution de probabilité conditionnelle basée sur ses parents dans le graphe.

Utilisation des réseaux bayésiens

- Les réseaux bayésiens sont utilisés pour représenter les dépendances probabilistes entre différentes variables aléatoires.

- Ils peuvent être utilisés pour effectuer des inférences et prendre des décisions basées sur ces dépendances.

- Il existe différents modèles probabilistes que l'on peut générer à partir des réseaux bayésiens.

Conclusion

Les réseaux bayésiens sont des outils puissants pour modéliser et raisonner sur les dépendances probabilistes entre différentes variables aléatoires. Ils sont largement utilisés dans le domaine de l'intelligence artificielle pour représenter et résoudre des problèmes complexes.

Distribution des probabilités pour la pluie

Aperçu de la section: Dans cette partie, le conférencier explique la distribution des probabilités pour les différents niveaux de pluie dans le réseau bayésien.

Distribution des probabilités pour la pluie

- La probabilité qu'il n'y ait pas de pluie est de 0,7.

- La probabilité d'une légère pluie est de 0,2.

- La probabilité d'une forte pluie est de 0,1.

Distribution des probabilités pour l'entretien des voies

Aperçu de la section: Le conférencier aborde maintenant la distribution des probabilités pour l'entretien des voies en fonction du niveau de pluie.

Distribution des probabilités pour l'entretien des voies

- Plus il pleut fort, moins il est probable qu'il y ait un entretien sur les voies.

- Les personnes chargées de l'entretien préfèrent attendre une journée moins pluvieuse.

Distribution conditionnelle pour l'entretien des voies

Aperçu de la section: Le conférencier présente une distribution conditionnelle pour l'entretien des voies en fonction du niveau de pluie.

Distribution conditionnelle pour l'entretien des voies

- Si aucune pluie, alors il y a une probabilité de 0,4 d'avoir un entretien et une probabilité de 0,6 de ne pas en avoir.

- En cas de forte pluie, la probabilité d'avoir un entretien est de 0,1 et la probabilité de ne pas en avoir est de 0,9.

Distribution conditionnelle pour le train

Aperçu de la section: Le conférencier explique maintenant une distribution conditionnelle pour le statut du train en fonction du niveau de pluie et de l'entretien des voies.

Distribution conditionnelle pour le train

- La distribution dépend à la fois du niveau de pluie et de l'entretien des voies.

- Différentes valeurs possibles pour le niveau de pluie et l'entretien des voies sont considérées.

- Chaque ligne représente une combinaison spécifique des valeurs possibles avec leurs probabilités associées.

Probabilité d'être à l'heure ou en retard selon les conditions météorologiques

Aperçu de la section: Le conférencier donne un exemple spécifique pour calculer la probabilité d'être à l'heure ou en retard en fonction du niveau léger de pluie et d'un entretien des voies effectué.

Probabilité d'être à l'heure ou en retard selon les conditions météorologiques

- Si le niveau léger de pluie est associé à un entretien des voies effectué, il y a une probabilité de 0,6 d'être à l'heure et une probabilité de 0,4 d'être en retard.

Ordre des nœuds dans le réseau bayésien

Aperçu de la section: Le conférencier discute de l'importance de l'ordre des nœuds dans le réseau bayésien et comment cela peut influencer les résultats.

Ordre des nœuds dans le réseau bayésien

- Certains nœuds ont une influence directe sur d'autres nœuds, tandis que d'autres ont une influence indirecte.

- L'ordre des nœuds est important pour déterminer quelles informations supplémentaires sont fournies par chaque nœud.

Influence de l'entretien des voies sur la ponctualité du train

Aperçu de la section: Le conférencier explique comment l'entretien des voies influence indirectement la ponctualité du train et, par conséquent, la présence ou l'absence à un rendez-vous.

Influence de l'entretien des voies sur la ponctualité du train

- L'entretien des voies a une influence indirecte sur la ponctualité du train.

- Si l'entretien est effectué, il est plus probable que le train soit en retard.

- Si le train est en retard, il est plus probable que quelqu'un manque son rendez-vous.

Distribution conditionnelle pour les rendez-vous

Aperçu de la section: Le conférencier présente une distribution conditionnelle pour les rendez-vous en fonction de la ponctualité du train.

Distribution conditionnelle pour les rendez-vous

- La distribution dépend uniquement de la ponctualité du train.

- Différentes valeurs possibles pour la ponctualité du train sont considérées.

- Chaque ligne représente une combinaison spécifique des valeurs possibles avec leurs probabilités associées.

Calcul des probabilités

Aperçu de la section: Le conférencier explique comment utiliser les distributions de probabilités pour effectuer des calculs dans le réseau bayésien.

Calcul des probabilités

- Les distributions de probabilités associées à chaque nœud permettent d'effectuer des calculs et des estimations.

- Il est possible de calculer la probabilité d'un événement spécifique en utilisant les distributions appropriées.

Conclusion

Aperçu de la section: Le conférencier récapitule l'importance du réseau bayésien et comment il peut être utilisé pour effectuer des calculs basés sur les probabilités.

Conclusion

- Le réseau bayésien permet de modéliser les relations entre différentes variables aléatoires.

- Les distributions de probabilités associées à chaque nœud fournissent les informations nécessaires pour effectuer des calculs et des estimations.

Calcul des probabilités conditionnelles

Aperçu de la section: Dans cette partie, l'orateur explique comment calculer les probabilités conditionnelles en utilisant un réseau bayésien. Il montre comment obtenir la probabilité d'un événement donné en fonction de l'évidence observée.

Calcul des probabilités conditionnelles

- La probabilité de non maintenance des voies étant dépendante de la pluie, on peut calculer la probabilité de non maintenance des voies sachant qu'il y a eu une légère pluie en multipliant la probabilité de légère pluie par la probabilité de non maintenance des voies sachant qu'il y a eu une légère pluie.

- On peut continuer à faire cela pour chaque variable que l'on souhaite ajouter dans le calcul de cette probabilité conjointe. Par exemple, pour calculer la probabilité de légère pluie et absence de maintenance des voies et train retardé, on multiplie les différentes valeurs correspondantes.

- Pour obtenir une probabilité conjointe sur toutes les variables, on multiplie les différentes valeurs correspondantes provenant des nœuds individuels du réseau bayésien.

Problème d'inférence probabiliste

Aperçu de la section: L'orateur introduit le problème d'inférence dans un contexte probabiliste. Il explique comment utiliser les informations disponibles pour déduire les probabilités d'autres variables.

Problème d'inférence probabiliste

- L'inférence consiste à déduire des conclusions sur d'autres faits en utilisant les informations disponibles. Dans le contexte probabiliste, il s'agit de déduire les probabilités de certaines valeurs pour d'autres variables en fonction des connaissances et des évidences observées.

- Le problème d'inférence comprend une requête (variable x dont on veut calculer la distribution), des variables d'évidence (variables observées) et des variables cachées (non observées). On cherche à calculer la distribution de probabilité de x sachant les évidences observées.

- Les variables cachées sont celles qui ne sont ni des évidences ni la requête. Elles représentent les informations manquantes que l'on souhaite inférer à partir des évidences observées.

Calcul de la distribution de probabilité

Aperçu de la section: L'orateur explique comment calculer la distribution de probabilité d'une variable donnée en utilisant les règles de probabilité.

Calcul de la distribution de probabilité

- Pour calculer la distribution de probabilité d'une variable donnée sachant certaines évidences, on peut utiliser les règles de probabilité déjà connues. On peut également utiliser des bibliothèques informatiques pour effectuer ces calculs mathématiques.

- L'objectif est d'obtenir une estimation précise des différentes valeurs possibles pour une variable donnée en fonction des évidences observées. Par exemple, on peut vouloir connaître la distribution probabiliste du retard du train sachant qu'il pleut.

Les sections ont été regroupées pour éviter de créer trop de sections courtes et pour organiser les informations de manière plus cohérente.

Distribution de la variable aléatoire "Rendez-vous"

Aperçu de la section: Dans cette partie, l'orateur explique son intérêt pour connaître la distribution de la variable aléatoire "Rendez-vous" et les chances d'assister ou de manquer un rendez-vous en fonction des preuves disponibles. Il mentionne également une variable cachée appelée "Train" qui n'est pas directement observée mais qui peut influencer le résultat.

Distribution conditionnelle proportionnelle à la probabilité jointe

- Une probabilité conditionnelle est proportionnelle à la probabilité jointe.

- La probabilité du rendez-vous donné une pluie légère et aucune maintenance des voies est proportionnelle à la probabilité conjointe de ces événements.

Calcul de la probabilité conjointe

- Pour calculer cette probabilité, il faut prendre en compte toutes les valeurs possibles pour les variables cachées.

- On utilise une méthode appelée marginalisation pour sommer toutes les configurations possibles des variables observées et cachées.

- On itère sur toutes les valeurs possibles de la variable cachée "Train" et on ajoute leurs probabilités correspondantes.

Inference par énumération

- Le processus d'inférence par énumération consiste à itérer sur toutes les valeurs possibles des variables cachées et à effectuer des calculs similaires pour obtenir une distribution probabiliste.

Signification des symboles dans l'inférence bayésienne

Aperçu de la section: L'orateur explique le sens des symboles utilisés dans l'inférence bayésienne et comment calculer la probabilité conditionnelle en marginalisant sur les variables cachées.

Probabilité conditionnelle proportionnelle à la probabilité jointe

- Une probabilité conditionnelle est proportionnelle à la probabilité jointe.

- On utilise un facteur de normalisation alpha pour obtenir une probabilité valide.

Marginalisation des variables cachées

- Pour calculer la probabilité conditionnelle, on marginalise sur toutes les variables cachées en sommant leurs valeurs possibles.

- On peut traduire cela en une somme sur toutes les valeurs possibles des variables cachées et ajouter les probabilités individuelles correspondantes.

Inférence par énumération

- L'inférence par énumération consiste à itérer sur toutes les valeurs possibles des variables cachées et à effectuer des calculs similaires pour obtenir une distribution probabiliste.

Utilisation de bibliothèques pour l'inférence bayésienne

Aperçu de la section: L'orateur explique qu'il existe plusieurs bibliothèques Python permettant de faciliter le processus d'inférence bayésienne. Il mentionne également que ces bibliothèques permettent de décrire la structure du réseau bayésien et d'effectuer des requêtes sans avoir à comprendre tous les détails mathématiques sous-jacents.

Bibliothèques pour l'inférence bayésienne

- Il existe plusieurs bibliothèques Python pour effectuer l'inférence bayésienne.

- Ces bibliothèques facilitent le processus d'inférence en permettant de décrire la structure du réseau bayésien et d'effectuer des requêtes sans connaître tous les détails mathématiques.

Utilisation de la bibliothèque pomegranate

- L'orateur utilise la bibliothèque pomegranate pour créer un réseau bayésien.

- Il crée des nœuds représentant les variables du réseau bayésien en spécifiant leurs distributions et probabilités correspondantes.

Simplification des calculs avec les bibliothèques

- Les bibliothèques permettent de simplifier les calculs d'inférence bayésienne en automatisant une grande partie du processus.

- Il suffit de décrire la structure du réseau et d'effectuer les requêtes appropriées pour obtenir les résultats souhaités.

Exemple d'utilisation d'une bibliothèque pour l'inférence bayésienne

Aperçu de la section: L'orateur explique qu'il va maintenant présenter un exemple concret d'utilisation d'une bibliothèque Python pour effectuer l'inférence bayésienne.

Choix de la bibliothèque pomegranate

- Il existe plusieurs bibliothèques Python pour effectuer l'inférence bayésienne, mais l'orateur a choisi d'utiliser pomegranate dans cet exemple.

Création du réseau bayésien avec pomegranate

- L'orateur montre comment créer un réseau bayésien en utilisant la syntaxe et la structure attendues par la bibliothèque pomegranate.

- Chaque variable est représentée par un nœud dans le réseau, avec sa distribution et ses probabilités correspondantes spécifiées.

Facilité d'utilisation des bibliothèques

- Les bibliothèques permettent de simplifier le processus d'inférence bayésienne en automatisant une grande partie des calculs.

- Il suffit de décrire la structure du réseau et d'effectuer les requêtes appropriées pour obtenir les résultats souhaités.

Conclusion

- Les bibliothèques Python facilitent l'utilisation de l'inférence bayésienne en fournissant des outils pour créer et manipuler des réseaux bayésiens.

- Elles permettent aux utilisateurs de se concentrer sur la structure du réseau et les requêtes, sans avoir à effectuer tous les calculs mathématiques manuellement.

Probabilités conditionnelles et réseaux bayésiens

Aperçu de la section: Dans cette partie, le conférencier explique comment les probabilités conditionnelles sont utilisées pour construire des réseaux bayésiens.

Construction d'un réseau bayésien

- Les probabilités conditionnelles sont utilisées pour encoder l'information dans un réseau bayésien.

- Un exemple est donné avec un nœud représentant la maintenance de la voie ferrée qui dépend de la pluie.

- Le conférencier montre comment spécifier les probabilités conditionnelles pour chaque combinaison possible des parents du nœud.

Modélisation d'un réseau bayésien

- Le conférencier décrit comment construire un réseau bayésien en ajoutant des nœuds et en reliant les nœuds dépendants par des arêtes.

- Il explique que Pomegranate est une bibliothèque Python utilisée pour créer des réseaux bayésiens, mais il existe d'autres bibliothèques similaires.

- L'idée clé est qu'une fois le modèle construit, il suffit de spécifier les distributions de probabilité pour chaque nœud afin de pouvoir effectuer des calculs logiques intéressants.

Calcul des probabilités jointes

Aperçu de la section: Dans cette partie, le conférencier utilise la bibliothèque Pomegranate pour calculer les probabilités jointes dans un réseau bayésien.

Calcul des probabilités jointes

- Le conférencier montre comment utiliser la fonction

model.probabilitypour calculer la probabilité d'une observation donnée dans le réseau bayésien.

- Un exemple est donné avec une observation où il n'y a pas de pluie, pas de maintenance de la voie ferrée, le train est à l'heure et il peut assister à sa réunion.

- Le conférencier exécute le code Python correspondant et obtient une probabilité d'environ 0,34 pour cette situation optimale.

Calcul d'autres probabilités

- Le conférencier explique qu'il est possible de calculer d'autres probabilités en utilisant la bibliothèque Pomegranate.

- Il donne un exemple où le train est à l'heure mais il manque quand même la réunion. La probabilité pour cette situation est d'environ 0,04.

Résolution des problèmes d'inférence

Aperçu de la section: Dans cette partie, le conférencier montre comment utiliser un réseau bayésien pour résoudre des problèmes d'inférence.

Utilisation du modèle pour l'inférence

- Le conférencier utilise la fonction

model.predict_probapour faire des prédictions sur les autres variables aléatoires du réseau bayésien en se basant sur une observation donnée.

- Un exemple est donné avec une observation où le train est en retard. Le conférencier affiche ensuite les distributions de probabilité résultantes pour les autres variables aléatoires.

Conclusion

- Les réseaux bayésiens permettent non seulement de calculer des probabilités jointes, mais aussi de résoudre des problèmes d'inférence en utilisant des observations spécifiques.

- La bibliothèque Pomegranate est utilisée comme exemple, mais d'autres bibliothèques similaires peuvent être utilisées pour construire et analyser des réseaux bayésiens.

Calcul des probabilités dans un réseau bayésien

Aperçu de la section: Dans cette partie, nous abordons le calcul des probabilités dans un réseau bayésien en utilisant l'exemple d'une personne essayant de déterminer la probabilité d'arriver à un rendez-vous à l'heure malgré une pluie intense et un retard de train.

Inférence exacte par énumération

- L'inférence exacte par énumération consiste à parcourir toutes les valeurs possibles des variables cachées et à calculer les probabilités correspondantes.

- Cette méthode devient inefficace lorsque le nombre de variables et de valeurs possibles devient important.

Inférence approximative par échantillonnage

- L'inférence approximative peut être réalisée en utilisant une méthode appelée échantillonnage.

- L'échantillonnage consiste à générer plusieurs exemples aléatoires en suivant les distributions de probabilité du réseau bayésien.

- En effectuant cet échantillonnage plusieurs fois, on obtient une estimation approximative des probabilités recherchées.

Avantages et limites de l'inférence approximative

- L'inférence approximative permet d'estimer rapidement les probabilités sans avoir besoin d'un calcul exact.

- Cependant, plus le nombre d'échantillons est grand, plus l'estimation sera précise.

- Il existe également des méthodes pour optimiser le processus d'échantillonnage afin d'éviter les calculs redondants.

Conclusion sur l'inférence dans les réseaux bayésiens

Aperçu de la section: Dans cette partie, nous concluons sur l'inférence dans les réseaux bayésiens et soulignons l'importance de l'approximation lorsque des calculs exacts sont difficiles ou coûteux.

- L'inférence exacte par énumération permet d'obtenir des probabilités précises mais devient inefficace pour les grands réseaux.

- L'inférence approximative par échantillonnage offre une alternative efficace en générant des exemples aléatoires selon les distributions de probabilité du réseau.

- L'utilisation de milliers ou de dizaines de milliers d'échantillons permet d'obtenir des estimations plus précises.

- L'inférence approximative est particulièrement utile lorsque la précision exacte n'est pas nécessaire et que des résultats proches suffisent.

Les méthodes d'échantillonnage peuvent être optimisées pour éviter les calculs redondants et améliorer l'efficacité globale du processus.

Calcul des probabilités conditionnelles

Aperçu de la section: Dans cette partie, l'orateur explique comment calculer les probabilités conditionnelles à l'aide de méthodes d'échantillonnage.

Méthode de l'échantillonnage par rejet

- L'orateur utilise la méthode de l'échantillonnage par rejet pour calculer les probabilités conditionnelles.

- La méthode consiste à exclure les échantillons qui ne correspondent pas à une certaine condition, puis à calculer la distribution de probabilité en fonction des échantillons restants.

- En utilisant cette méthode, il est possible d'obtenir une approximation de la probabilité recherchée.

Implémentation de l'échantillonnage par rejet

- L'orateur présente un programme appelé "sample.py" qui implémente l'échantillonnage par rejet.

- Le programme génère des échantillons en bouclant sur tous les états du modèle probabiliste.

- Pour chaque échantillon, seuls ceux qui satisfont aux conditions spécifiées sont pris en compte.

- Les résultats sont ensuite collectés et analysés pour obtenir la distribution de probabilité souhaitée.

Résultats et amélioration

- En exécutant le programme avec un nombre suffisamment grand d'échantillons, on peut obtenir une estimation précise des probabilités conditionnelles.

- Il est important d'utiliser un grand nombre d'échantillons pour augmenter la confiance dans les résultats obtenus.

- L'échantillonnage par rejet est une méthode approximative mais efficace pour calculer les probabilités conditionnelles.

Méthode de pondération de vraisemblance

Aperçu de la section: Dans cette partie, l'orateur présente une autre méthode d'échantillonnage appelée "pondération de vraisemblance" qui permet d'éviter le rejet des échantillons.

Méthode de pondération de vraisemblance

- La méthode de pondération de vraisemblance est une alternative à l'échantillonnage par rejet.

- Au lieu d'exclure les échantillons qui ne correspondent pas aux conditions, on fixe les valeurs des variables pertinentes et on échantillonne les autres variables.

- Cette méthode permet d'utiliser tous les échantillons générés sans en rejeter aucun.

Avantages et limitations

- La méthode de pondération de vraisemblance évite le gaspillage d'échantillons et peut être plus efficace lorsque les conditions sont peu probables.

- Cependant, elle nécessite également un grand nombre d'échantillons pour obtenir des résultats précis.

- Il existe plusieurs méthodes d'échantillonnage disponibles, chacune ayant ses avantages et ses limitations. Le choix dépend du contexte spécifique et des contraintes du problème.

Les sections ont été organisées chronologiquement selon le contenu du transcript.

Poids des échantillons en fonction de leur probabilité

Aperçu de la section: Dans cette section, l'orateur explique comment pondérer les échantillons en fonction de leur probabilité pour obtenir une distribution plus précise.

Pondération des échantillons par leur probabilité

- Les échantillons sont pondérés en fonction de leur probabilité d'apparition.

- La probabilité est définie comme la probabilité de toutes les preuves disponibles.

- Chaque échantillon est multiplié par sa probabilité pour obtenir une distribution plus précise.

Procédure d'échantillonnage avec des variables d'évidence fixées

Aperçu de la section: L'orateur explique comment effectuer un échantillonnage en fixant les variables d'évidence et en générant des poids pour chaque échantillon.

Procédure d'échantillonnage avec des variables d'évidence fixées

- Lorsque les variables d'évidence sont fixées, on peut effectuer un échantillonnage sans avoir à rejeter certains échantillons.

- Les variables d'évidence sont celles dont on connaît déjà les valeurs attendues.

- On génère un échantillon en fixant les variables d'évidence et en échantillonnant les autres variables.

- Le dernier pas consiste à attribuer un poids à chaque échantillon basé sur la probabilité que l'évidence se soit produite.

Méthodes d'échantillonnage alternatives

Aperçu de la section: L'orateur mentionne qu'il existe d'autres méthodes d'échantillonnage pour approximer la procédure d'inférence.

Méthodes d'échantillonnage alternatives

- Il existe différentes méthodes d'échantillonnage pour approximer la procédure d'inférence.

- Chaque échantillon reçoit un poids en fonction de la probabilité de l'évidence associée.

- Ces méthodes visent à estimer la valeur d'une variable.

Modélisation des variables dans le temps

Aperçu de la section: L'orateur aborde le concept de modélisation des variables dans le temps et comment les valeurs peuvent changer au fil du temps.

Modélisation des variables dans le temps

- Les variables peuvent changer au fil du temps, ce qui nécessite une modélisation appropriée.

- On peut utiliser une variable aléatoire pour chaque pas de temps pour représenter les valeurs au fil du temps.

- La Markov Chain est utilisée lorsque chaque variable dépend uniquement d'un nombre fini et fixe de variables précédentes.

L'hypothèse de Markov

Aperçu de la section: L'orateur explique l'hypothèse de Markov, qui simplifie l'analyse en supposant que l'état actuel dépend seulement d'un nombre fini et fixe d'états précédents.

L'hypothèse de Markov

- Selon l'hypothèse de Markov, l'état actuel dépend seulement d'un nombre fini et fixe d'états précédents.

- Cela permet de prédire l'état actuel en se basant sur un nombre limité d'états précédents.

- En utilisant cette hypothèse, on peut créer une Markov Chain où chaque variable suit cette hypothèse.

Prédiction du temps qu'il fait

Aperçu de la section: L'orateur explique comment utiliser la Markov Chain pour prédire le temps qu'il fera en se basant sur les jours précédents.

Prédiction du temps qu'il fait

- On peut utiliser la Markov Chain pour prédire le temps qu'il fera en se basant sur les jours précédents.

- Chaque jour est prédit en fonction du temps de la veille.

- Une matrice peut être utilisée pour représenter les probabilités de transition entre les différents états météorologiques.

Modèle de transition

Aperçu de la section: Dans cette partie, le conférencier explique comment construire un modèle de Markov en utilisant un modèle de transition. Il montre comment prédire la météo de demain en fonction de la météo d'aujourd'hui.

Modèle de transition

- Le modèle de transition décrit comment passer d'un état à l'état suivant.

- En utilisant ce modèle, on peut prédire la météo de demain en fonction de la météo d'aujourd'hui.

- Un exemple est donné où si aujourd'hui il fait beau, avec une probabilité de 0,8, il fera aussi beau demain et avec une probabilité de 0,2, il pleuvra.

- De même, si aujourd'hui il pleut, avec une probabilité de 0,7, il pleuvra demain et avec une probabilité de 0,3, il fera beau.

Construction d'une chaîne Markov

Aperçu de la section: Le conférencier explique comment construire une chaîne Markov en utilisant le modèle de transition. Il montre comment échantillonner les prévisions météorologiques pour former une chaîne Markov.

Construction d'une chaîne Markov

- En utilisant le modèle de transition, on peut construire une chaîne Markov en prédisant la météo future en fonction des données actuelles.

- On peut échantillonner les prévisions météorologiques pour former une chaîne Markov.

- La chaîne suit un certain schéma en fonction de la distribution donnée par le modèle de transition.

- On peut effectuer des analyses sur cette chaîne Markov et poser des questions de probabilité.

Utilisation de bibliothèques Python pour les modèles probabilistes

Aperçu de la section: Le conférencier mentionne l'existence de bibliothèques Python pour interagir avec des modèles probabilistes basés sur l'assomption de Markov. Il présente également la bibliothèque "pomegranate" comme un exemple.

Utilisation de bibliothèques Python

- Il existe plusieurs bibliothèques Python pour interagir avec des modèles probabilistes basés sur l'assomption de Markov.

- La bibliothèque "pomegranate" est mentionnée comme un exemple.

- Cette bibliothèque permet de manipuler ces variables et distributions basées sur les variables précédentes selon l'assomption de Markov.

Définition d'un modèle Markov

Aperçu de la section: Le conférencier explique comment définir un modèle Markov en utilisant une syntaxe similaire à celle présentée précédemment. Il montre comment définir les distributions initiales et le modèle de transition.

Définition d'un modèle Markov

- Tout modèle Markov commence à un certain moment dans le temps et nécessite une distribution initiale.

- Les distributions initiales sont définies pour chaque état possible du système.

- Le modèle de transition est également défini, indiquant comment passer d'un jour à l'autre en fonction des probabilités spécifiées.

- Ces définitions permettent de construire un modèle Markov et de répondre à des questions en utilisant ce modèle.

Échantillonnage à partir d'une chaîne Markov

Aperçu de la section: Le conférencier montre comment échantillonner à partir d'une chaîne Markov pour simuler différentes instances de prévisions météorologiques.

Échantillonnage à partir d'une chaîne Markov

- Il est possible d'échantillonner à partir d'une chaîne Markov pour simuler différentes instances de prévisions météorologiques.

- Cela peut être fait en utilisant une méthode intégrée dans la bibliothèque de chaînes Markov.

- L'échantillonnage permet d'obtenir des données supplémentaires pour effectuer davantage d'analyses sur le modèle.

Modèles avec des états cachés

Aperçu de la section: Le conférencier explique que souvent, l'état réel du monde est inconnu, mais il est possible d'obtenir des informations sur cet état grâce à des capteurs. Il introduit les modèles avec des états cachés et les modèles de capteurs.

Modèles avec des états cachés

- Dans certains cas, l'état réel du monde est inconnu, mais il est possible d'obtenir des informations sur cet état grâce à des capteurs.

- Les modèles avec des états cachés permettent de décrire comment traduire l'état caché en observations.

- Par exemple, un robot peut avoir des données de capteurs pour détecter les obstacles autour de lui, même s'il ne connaît pas exactement sa position.

- Les modèles de capteurs permettent d'inférer l'état caché à partir des observations.

Inférence à partir des observations

Aperçu de la section: Le conférencier explique comment utiliser les informations observées pour inférer l'état caché. Il donne l'exemple d'un robot qui utilise des données de capteurs pour estimer sa position.

Inférence à partir des observations

- Les informations observées peuvent être utilisées pour inférer l'état caché.

- Par exemple, un robot peut utiliser les données de ses capteurs pour estimer sa position réelle.

- L'état caché influence les observations, même si le robot ne connaît pas exactement cet état.

- Les modèles probabilistes permettent d'effectuer cette inférence et d'estimer l'état réel du monde à partir des observations.

The transcript provided is a partial transcript and may not cover all the content of the video.

Comprendre les états cachés et les observations

Aperçu de la section: Dans cette partie, nous abordons le concept d'états cachés et d'observations dans le contexte de l'intelligence artificielle. Nous explorons comment les modèles d'apprentissage automatique peuvent inférer des informations sur des états cachés à partir d'observations.

Modélisation des états cachés et des observations

- Les appareils tels que les téléphones ou les assistants domestiques ne connaissent pas exactement les mots prononcés par l'utilisateur, mais ils ont accès à des formes d'ondes audio.

- Les formes d'ondes audio dépendent de l'état caché, mais permettent d'inférer les mots prononcés.

- De même, sur un site web, on peut observer des données telles que le nombre de clics sur un bouton ou l'interaction avec une page pour en déduire des informations sur les utilisateurs.

Inférence à partir d'états cachés

- L'intelligence artificielle ne connaît pas directement l'état réel du monde, elle n'a accès qu'à une observation liée à cet état.

- Il peut y avoir du bruit dans ces observations qui rend difficile la conclusion certaine de l'état caché.

- Un exemple simple est celui de prédire la météo en observant si les employés apportent ou non un parapluie au bureau.

Modèle de Markov caché (HMM)

- Pour modéliser ce type de problème avec des états cachés et des observations, nous utilisons un modèle appelé Hidden Markov Model (HMM).

- Le HMM permet de représenter les transitions entre les états cachés et les émissions observées.

- Il comprend un modèle de transition pour prédire l'état futur en fonction de l'état actuel, ainsi qu'un modèle d'observation pour prédire l'émission en fonction de l'état.

Modèle du capteur

- Le modèle du capteur est également appelé probabilités d'émission, car il décrit comment les états cachés émettent des observations.

- Les probabilités d'émission dépendent uniquement de l'état correspondant, par exemple, si le temps est ensoleillé ou pluvieux.

- Bien que cette hypothèse puisse ne pas être toujours vraie dans la pratique, elle simplifie le raisonnement sur les probabilités.

Structure du HMM

- Un HMM se compose d'une chaîne d'états cachés connectée par une matrice de transition et chaque état produit une émission observée.

- Les observations permettent de prédire avec une certaine probabilité quel est l'état caché même si on ne peut pas observer directement cet état.

Conclusion et représentation des états cachés

Aperçu de la section: Dans cette partie, nous concluons notre discussion sur les modèles à états cachés et explorons leur représentation graphique.

Représentation graphique des HMM

- Un HMM peut être représenté graphiquement avec des états cachés reliés par des transitions et des émissions associées à chaque état.

- Cette représentation visuelle facilite la compréhension du modèle et permet d'analyser les probabilités de transition et d'émission.

Utilité des HMM

- Les HMM sont utiles pour modéliser des systèmes où les états cachés ne peuvent pas être directement observés mais peuvent être inférés à partir d'observations.

- Ils sont utilisés dans de nombreux domaines tels que la reconnaissance vocale, la traduction automatique et l'analyse du comportement utilisateur.

Limitations des HMM

- Les HMM supposent souvent des hypothèses simplificatrices telles que l'indépendance entre les états et les observations, ce qui peut ne pas correspondre à la réalité.

- Dans certains cas, d'autres modèles plus complexes peuvent être nécessaires pour représenter avec précision les relations entre les états cachés et les observations.

Récapitulatif final

Aperçu de la section: Dans cette dernière partie, nous résumons les principaux points abordés dans cette vidéo sur les modèles à états cachés.

- Les modèles à états cachés permettent de représenter des systèmes où il existe un état sous-jacent non observable mais qui peut être inféré à partir d'observations.

- Le modèle de Markov caché (HMM) est une approche courante pour modéliser ces problèmes.

- Un HMM se compose d'une chaîne d'états cachés reliée par des transitions et chaque état émet une observation.

- Le modèle du capteur décrit comment chaque état émet une observation en fonction de cet état.

- Les HMM sont utilisés dans divers domaines tels que la reconnaissance vocale, la prédiction météorologique et l'analyse du comportement utilisateur.

- Cependant, les HMM ont des limitations et peuvent nécessiter des hypothèses simplificatrices qui ne correspondent pas toujours à la réalité.

Ces notes fournissent un aperçu clair et concis des concepts abordés dans la vidéo, en utilisant les timestamps pour faciliter l'étude du contenu.

Inférence dans les modèles de Markov cachés

Aperçu de la section: Dans cette section, nous abordons les tâches possibles liées à l'inférence dans les modèles de Markov cachés. Ces tâches sont basées sur des probabilités conditionnelles et utilisent des distributions de probabilité pour tirer des conclusions.

Tâches d'inférence dans les modèles de Markov cachés

- La première tâche est le filtrage, qui consiste à calculer la distribution pour l'état actuel en fonction des observations depuis le début jusqu'à maintenant. Cela permet de déterminer s'il fait soleil ou s'il pleut aujourd'hui.

- Une autre tâche est la prédiction, qui consiste à utiliser les observations passées pour prédire l'état futur. Par exemple, on peut prédire s'il fera soleil ou s'il pleuvra demain.

- On peut également effectuer une rétrogradation (smoothing) en utilisant les observations passées pour calculer les distributions pour un état passé. Par exemple, on peut estimer la probabilité qu'il ait plu hier en se basant sur deux jours d'observations où il y avait des parapluies.

Tâche d'explication la plus probable

Aperçu de la section: Dans cette section, nous explorons la tâche d'explication la plus probable dans les modèles de Markov cachés. Cette tâche consiste à trouver la séquence d'états la plus probable qui correspond aux observations données.

- La tâche d'explication la plus probable est souvent utilisée dans des domaines tels que la reconnaissance vocale, où l'on cherche à trouver la séquence de mots ou de sons la plus probable en fonction des observations audio.

- En utilisant les données fournies au modèle de Markov caché, on peut prédire les états les plus probables qui ont généré les observations.

Modélisation d'un modèle de Markov caché

Aperçu de la section: Dans cette section, nous examinons comment modéliser un modèle de Markov caché. Nous définissons les états possibles, les probabilités d'émission et le modèle de transition.

- Les états possibles sont "soleil" et "pluie", avec des probabilités d'émission associées pour chaque observation (parapluie ou pas de parapluie).

- Un modèle de transition est utilisé pour déterminer les probabilités qu'un état suive un autre. Par exemple, si aujourd'hui il fait soleil, demain il est plus probable qu'il fasse encore soleil.

Inférence dans un modèle de Markov caché

Aperçu de la section: Dans cette section, nous explorons comment effectuer une inférence dans un modèle de Markov caché en utilisant des bibliothèques Python.

- En donnant une liste d'observations au programme, on peut calculer l'explication la plus probable pour ces observations. Par exemple, on peut déterminer s'il a plu ou s'il a fait soleil en se basant sur une série d'observations.

- Les bibliothèques Python peuvent faciliter le processus d'inférence en utilisant des fonctions prédéfinies pour effectuer les calculs.

L'utilisation de modèles de Markov cachés pour traiter l'incertitude

Aperçu de la section: Dans cette section, nous explorons comment l'intelligence artificielle peut traiter l'incertitude en utilisant des modèles de Markov cachés.

- Les modèles de Markov cachés permettent de formuler des problèmes avec des états cachés et des émissions observées. Cela permet d'utiliser des algorithmes d'inférence pour résoudre ces problèmes.

- En formulant un problème sous forme de modèle de Markov caché, on peut utiliser les algorithmes existants pour effectuer une inférence et obtenir des réponses précises.

Ces notes fournissent un aperçu clair et concis du contenu du transcript, en mettant l'accent sur les tâches d'inférence dans les modèles de Markov cachés et leur utilisation pour traiter l'incertitude. Les timestamps sont utilisés pour faciliter l'étude du transcript.

Des modèles probabilistes pour l'IA

Aperçu de la section: Dans cette partie, le conférencier parle des modèles probabilistes tels que les chaînes de Markov et les modèles de Markov cachés qui permettent de décrire comment certains événements sont liés à d'autres événements ou comment les valeurs de certaines variables sont liées à d'autres variables, avec une certaine distribution de probabilité. L'utilisation de ces modèles existants facilite l'utilisation des bibliothèques Python pour produire des effets souhaités. Cela permet à l'IA de traiter des problèmes incertains sans avoir besoin d'une certitude absolue.

Modèles probabilistes pour l'IA

- Les modèles probabilistes comme les chaînes de Markov et les modèles de Markov cachés permettent de décrire les relations entre différents événements ou variables.

- Ces modèles utilisent des distributions de probabilité pour représenter l'incertitude dans les prédictions.

- En utilisant des bibliothèques Python qui implémentent ces modèles, on peut facilement utiliser ces outils pour obtenir des résultats souhaités.

- Les modèles probabilistes aident l'IA à traiter des problèmes incertains sans avoir besoin d'une connaissance absolue.

L'importance du traitement du problème incertain

Aperçu de la section: Dans cette partie, le conférencier souligne l'importance du traitement des problèmes incertains par l'intelligence artificielle. Il explique que l'IA n'a pas besoin d'avoir une connaissance absolue et peut fonctionner efficacement en utilisant des modèles probabilistes.

Traitement des problèmes incertains

- L'IA n'a pas besoin de connaître les choses avec certitude absolue.

- Les modèles probabilistes permettent à l'IA de traiter des problèmes incertains en utilisant des distributions de probabilité.

- Cela permet à l'IA d'être efficace même lorsque les informations sont incomplètes ou incertaines.

- Les modèles probabilistes aident l'IA à prendre des décisions basées sur la probabilité plutôt que sur une certitude absolue.